Die Beziehung zwischen Nvidia und dem chinesischen Rechenzentrumsmarkt wirkt inzwischen wie eine Endlosserie mit immer neuen Wendungen. Monatelang erklärte der Konzern seinen Anlegern, man habe das China-Geschäft wegen der immer schärferen US-Exportkontrollen praktisch auf null abgeschrieben. Jetzt kommt plötzlich die Nachricht: Die Hopper-basierte H200 darf wieder nach China exportiert werden.

Auf den ersten Blick klingt das nach einem Comeback. In der Praxis ist es eher ein schmaler Notausgang – mit einer 25-prozentigen Abgabe pro Chip, politisch engen Leitplanken und einem Markt, der sich in Rekordzeit Richtung einheimischer Lösungen gedreht hat.

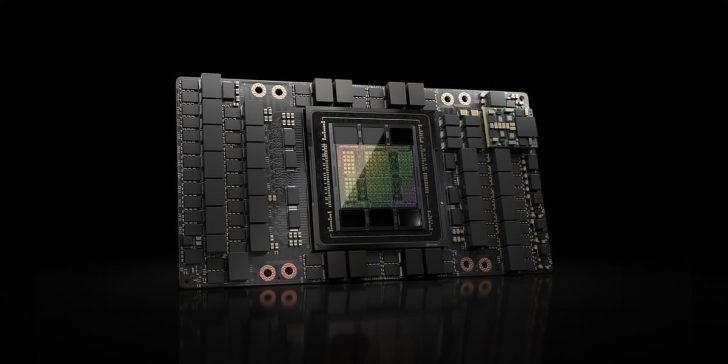

Über Jahre hinweg war China einer der wichtigsten Auslandsmärkte für Nvidia im Datacenter-Bereich. A100- und später H100-Beschleuniger wurden zur Standardausrüstung in den Cloud- und KI-Stacks von Baidu, Alibaba, Tencent und vielen anderen, sie trieben Empfehlungssysteme, Cloud-Services und die ersten Wellen großer Sprachmodelle an. Diese Wachstumsstory brach abrupt ab, als Washington Schritt für Schritt die Schrauben anzog: erst das Verbot der Vollversionen A100 und H100, dann die erzwungene Entwicklung von Sondervarianten wie A800, H800 und H20, deren Rechenleistung und Bandbreite bewusst unter die definierten Grenzwerte gedrückt wurden. Mit der nächsten Runde verschärfter Regeln fielen selbst diese Kompromissprodukte aus dem Rahmen. Jensen Huang sprach offen davon, dass man den China-Anteil im Datacenter-Geschäft weitgehend ausgebucht habe.

Die neue H200-Freigabe schreibt diese Geschichte nicht zurück, sie ergänzt lediglich eine Fußnote mit vielen Sternchen. Der wichtigste Punkt: Für jede H200, die nach China geht, wird eine Art Exportabgabe von 25 Prozent fällig. Das ist faktisch ein Sonderzoll auf Hochleistungs-GPUs, oben drauf auf ohnehin hohen Einstiegspreisen. Nvidia steht damit vor einer unattraktiven Wahl: entweder die eigenen Margen deutlich zusammenschmelzen lassen oder den Aufschlag an die chinesischen Kunden weiterreichen und die ohnehin teuren Server nochmals verteuern. In beiden Varianten verliert die H200 einen großen Teil ihres Preisschild-Charmes – besonders in einem Umfeld, das ohnehin gezwungen wurde, sich nach Alternativen umzusehen.

Parallel dazu hat Peking die Spielregeln für den heimischen Infrastrukturmarkt neu sortiert. Leitlinien für Behörden, Staatsunternehmen und alle Cloudanbieter, die auf staatliche Aufträge angewiesen sind, bevorzugen zunehmend heimische Beschleuniger in neuen Rechenclustern, vor allem bei Inferenz-Workloads. Aus der Branche heißt es, dass in Ausschreibungen teils explizit steht: Wer Nvidia-, AMD- oder Intel-GPUs anbietet, fliegt automatisch aus dem Rennen. Vor diesem Hintergrund wirkt der späte Segen aus Washington wie ein klassischer Fall von zu wenig, zu spät. Ein Teil der großen Projekte ist längst fest in der Hand lokaler Anbieter, und das Spielfeld, auf dem US-Chips überhaupt noch mitspielen dürfen, wird immer kleiner.

Möglich wurde diese Verschiebung, weil die chinesische Industrie nicht abgewartet hat, bis US-Behörden ihre Meinung ändern. Huawei hat die Ascend-910B- und 910C-Reihe aggressiv vorangetrieben, Designer wie Cambricon versuchen ebenfalls, sich als feste Größe in chinesischen Rechenzentren zu etablieren. In Marketingfolien und ausgewählten Benchmarks werden diese Beschleuniger offen mit Hopper-Chips verglichen – mit Versprechen, in bestimmten Szenarien auf Augenhöhe oder sogar darüber zu liegen. Gleichzeitig wird an einem umfassenderen Projekt gearbeitet: einem technologischen Souveränitäts-Stack von der Betriebssystemebene über die Cloud-Schicht bis hin zu eigenen KI-Frameworks und Bibliotheken. Es geht längst nicht nur um Chatbots, sondern um die Kontrolle über die Rechenbasis für Finanzsysteme, Telekommunikation, Überwachung und Industrie.

Trotzdem verfügt Nvidia noch über einen Joker, den die lokale Konkurrenz nicht so schnell kopieren kann: das Software-Ökosystem. Aus jahrelangen Investitionen in CUDA, cuDNN und eine breite Palette an Libraries, Compilern und Tools ist ein De-facto-Standard für modernes KI-Training und -Deployment geworden. Erfahrungsberichte aus chinesischen Labs und Start-ups, die große Modelle auf heimische Beschleuniger portieren wollen, klingen auffallend ähnlich: unreife Toolchains, Lücken im Framework-Stack, wackelige Treiber, fehlende Entsprechungen für viele CUDA-optimierte Bausteine. Teams investieren Monate in das Umschreiben von Kerneln, die Jagd auf schwer reproduzierbare Bugs und das Tuning schwankender Performance. Manche Unternehmen ziehen am Ende die pragmatische Option vor und mieten Rechenzeit in ausländischen Clouds, statt ihre gesamte Pipeline auf eine noch unreife Plattform zu migrieren.

Genau hier könnte die H200 trotz allem eine Nische finden. Firmen, die nicht komplett an staatliche Beschaffungsvorgaben gebunden sind und deren Codebasis tief in CUDA verankert ist, könnten zu dem Schluss kommen, dass ein teurerer Nvidia-Cluster am Ende günstiger ist als monatelange Umbaumaßnahmen. Besonders für Player, die global mitziehen wollen und keinen Spielraum für lange Technikpausen haben, kann Zeit der entscheidende Faktor sein – selbst wenn jede GPU eine satte Exportabgabe mit sich bringt.

Der politische Unterton dieser Entscheidung lässt sich trotzdem nicht ausblenden. Als erste Gerüchte über eine speziell für China angepasste H200-Variante auftauchten, betonte Jensen Huang noch, dass China ein Produkt mit zu starker Leistungsbremse schlicht nicht akzeptieren werde. Heute erleben wir eine spiegelverkehrte Situation: Washington signalisiert Bereitschaft, eine ganze Generation wieder zuzulassen – allerdings mit einem finanziellen „Tribut“ pro Chip –, während Peking seine Beschaffungsregeln so auslegt, dass die größten Aufträge bevorzugt auf heimische Silizium-Anbieter zulaufen. Kritiker sehen in der 25-Prozent-Abgabe einen improvisierten Baustellenersatz für eine aufgeweichte Unternehmensbesteuerung: Statt das Steuersystem insgesamt zu modernisieren, wird eine Sonderschraube an einem hochpolitischen Produkt gesetzt.

Hinzu kommt, dass sich die Freigabe strikt auf Hopper beschränkt. Die nächste GPU-Generation von Nvidia – Blackwell, gefolgt von Rubin – gilt in der Branche bereits als nächster großer Sprung bei Leistung, Speicherbandbreite und Effizienz. Diese Plattformen bleiben für China ausdrücklich gesperrt. Medienberichte deuten darauf hin, dass AMD ähnliche, aber ebenfalls streng begrenzte Öffnungen für einzelne KI-Beschleuniger erreicht hat. Die Botschaft aus den USA bleibt eindeutig: China darf in genau definierten Grenzen auf leicht abgerüstete Chips von gestern zugreifen, aber nicht auf die Spitzenklasse von morgen. An der Börse wird dieses Detail genau eingepreist. Auf euphorische Kurssprünge nach „Lockern“-Schlagzeilen folgen immer wieder Korrekturen, sobald klar wird, wie eng der tatsächliche Handlungsspielraum der Konzerne bleibt.

Über den Einzelfall hinaus erzählt die H200-Geschichte viel über das neue Kräfteverhältnis zwischen Staat und Tech-Konzernen. Die KI-Chip-Rivalität macht sichtbar, wie eng staatliche Interessen und privatwirtschaftliche Strategien miteinander verwoben sind – in Washington genauso wie in Peking. Für die einen wirkt der Exportzuschlag wie ein halbtransparenter Versuch, fiskalische Löcher zu stopfen, die jahrelang durch niedrigere Unternehmenssteuern aufgerissen wurden. Für andere ist klar, dass jede einzelne Exportlizenz, die zur außenpolitischen Waffe wird, den Druck auf Länder im globalen Süden erhöht, eigene Halbleiter-Stacks aufzubauen – und damit einen einst halbwegs integrierten Markt in viele konkurrierende Inseln zerlegt.

Für Nvidia bleibt der Weg zurück nach China damit eng, teuer und politisch riskant. Selbst wenn die H200-Stückzahlen spürbar anziehen sollten, ist kaum damit zu rechnen, dass sie den ausgelassenen Boom der Vor-Sanktionsjahre wiederholen. Inländische Beschleuniger werden besser, regulatorische Barrieren höher, und die wirklich modernsten Blackwell- und Rubin-Plattformen sind ausdrücklich ausgeschlossen. Gleichzeitig ringt die chinesische Industrie weiterhin mit Software-Lücken, und viele Entwickler bleiben aus Gewohnheit und Produktivität an das Nvidia-Ökosystem gebunden. In diesem Spannungsfeld ist die H200-Freigabe weder bedeutungslos noch ein durchschlagender Erfolg. Sie ist ein weiterer Zug in einer langfristigen Partie, in der rohe Rechenleistung, Entwicklervertrauen und nationale Industriepolitik untrennbar ineinandergreifen.