NVIDIA hebt die Messlatte für künstliche Intelligenz erneut an. Auf dem OCP Global Summit stellte das Unternehmen seine nächste Rack-Generation namens Kyber vor – den Nachfolger der bisherigen Oberon-Architektur.

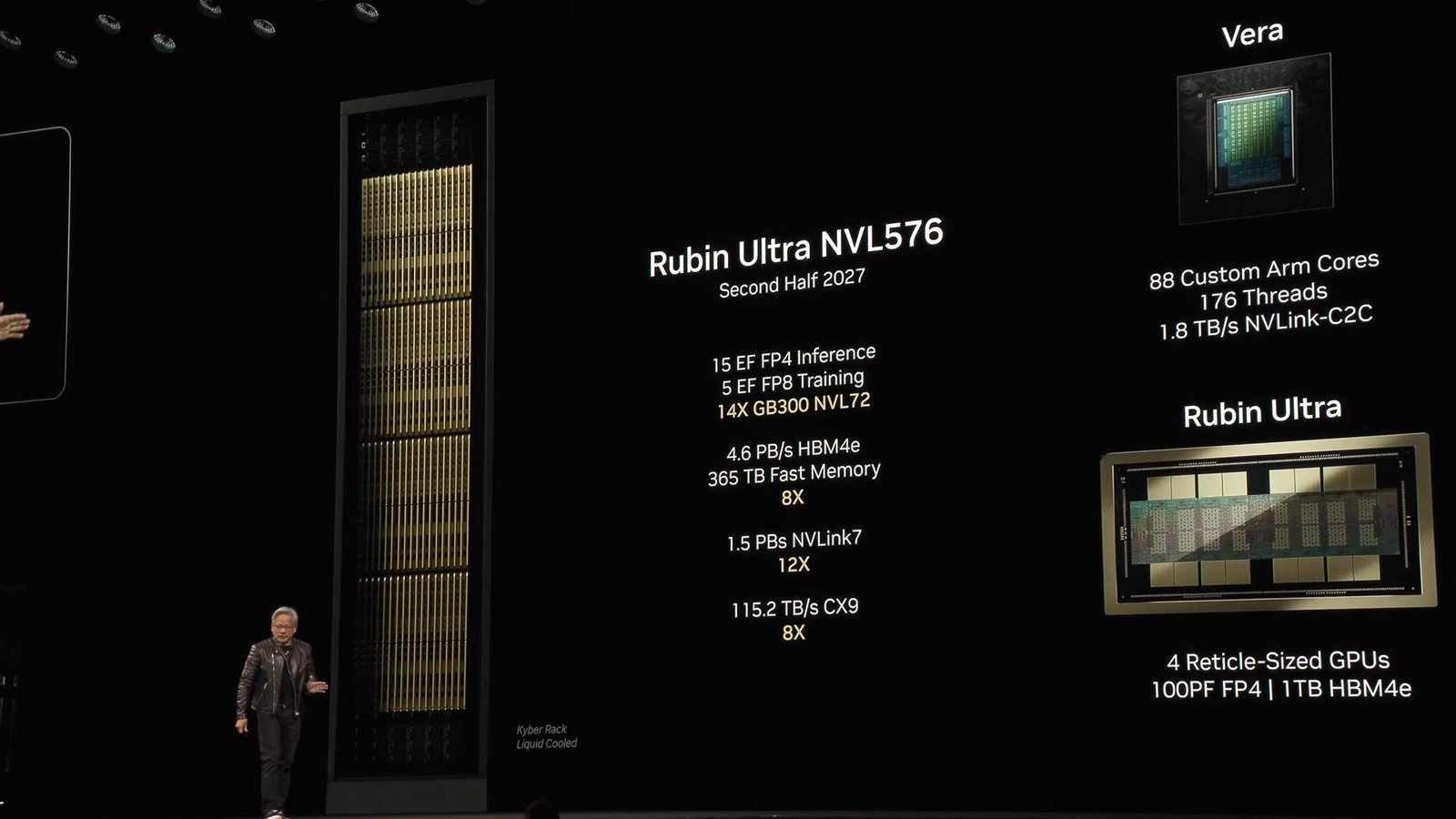

Ziel ist es, bis 2027 bis zu 576 Rubin Ultra GPUs in einem einzigen Rack zu vereinen. Damit will NVIDIA eine völlig neue Klasse von Hochleistungsrechenzentren schaffen – echte „KI-Fabriken“ für das kommende Jahrzehnt.

Zur Einordnung: Kyber und Oberon sind interne Codenamen für NVIDIAs Rack-Designs – sie definieren, wie GPUs, Stromversorgung und Kühlung angeordnet und miteinander verbunden sind. Während Oberon die Basis für die Blackwell-Server (GB200/GB300) bildete, läutet Kyber eine neue Ära ein. Das System soll höhere Dichte, bessere Energieeffizienz und flexiblere Wartung bieten – entscheidende Faktoren, wenn Rechenzentren immer größer und energiehungriger werden.

Ein zentraler Fortschritt ist die vertikale Anordnung der Module. Anstatt die Komponenten horizontal zu stapeln, werden sie künftig wie Bücher im Regal aufrecht montiert. Diese „Vertical Blade“-Struktur ermöglicht eine deutlich höhere GPU-Dichte, bessere Luftzirkulation und einfacheren Zugang bei Wartung. Zusätzlich integriert NVIDIA NVLink-Switch-Blades direkt in das Rack, was die interne Kommunikation massiv beschleunigt und die Skalierbarkeit auf Tausende von GPUs vereinfacht.

Auch bei der Energieversorgung wagt NVIDIA einen großen Schritt: Das neue System nutzt 800 VDC-Gleichstrom statt der bisherigen 415–480 Volt-Wechselstromlösungen. Das Ergebnis: 150 % mehr Energieübertragung über die gleichen Kupferleitungen – und somit enorme Einsparungen bei Material und Betriebskosten. In Zeiten, in denen Stromverbrauch und Kühlung zu den größten Herausforderungen von Rechenzentren zählen, ist dieser Ansatz ein echter Gamechanger.

Parallel dazu arbeitet das OCP-Ökosystem bereits an neuen Standards für Flüssigkühlung, mechanische Strukturen und Strommodule, um Kyber optimal zu unterstützen. Damit ebnet NVIDIA den Weg für KI-Cluster, die Modelle mit Billionen von Parametern trainieren können – Dimensionen, die vor wenigen Jahren noch undenkbar waren.

Natürlich bleibt die Konkurrenz nicht still. Einige Kritiker vermuten, dass die Zahl „576 GPUs“ geschönt sei, da mehrere Chips pro Modul gezählt würden – real also eher 144 GPUs. AMD-Fans verweisen stolz auf kommende MI450- und MI500-Modelle, die angeblich im 2-nm-Prozess gefertigt werden, während NVIDIAs Rubin auf 3 nm basiert. Der Konkurrenzkampf zwischen den Chipgiganten geht also in die nächste Runde.

Eines steht fest: Mit Kyber zementiert NVIDIA seinen Anspruch, die Grundlage moderner KI-Infrastruktur zu bestimmen. Ob Marketing oder echter Technologiesprung – das System könnte 2027 zum Standard für Supercluster werden, die unsere KI-Zukunft antreiben.

2 kommentare

800 Volt? Ich hoffe, die Techniker kriegen Gefahrenzulage 😅

Wie teuer soll so ein Rack bitte werden? Mondpreise incoming..